Nuit Blanche des Chercheur·es 2024 - Atelier "Humain augmenté et un peu paumé".

Depuis 2017, Nantes Université organise annuellement la Nuit Blanche des Chercheur·es (NBC), un événement festif qui contribue à rapprocher la recherche du grand public. Chaque édition porte sur une thématique différente, offrant au grand public l’opportunité de rencontrer des chercheur·es, découvrir des projets et discuter des enjeux futurs. L’édition 2024, intitulée “Sens dessus-dessous”, s’est déroulée le 8 février à Stereolux et à la Halle 6 Ouest.

La Chaire Unesco RELIA était présente avec une thématique un poil particulière et provoc’ : “Humain augmenté et un peu paumé”. Cela suscite votre curiosité ? Allez, venez embarquer avec les membres de l’équipe pour des témoignages sur chacune de nos activités !

sous licence CC BY-NC-ND 3.0 FR – Jeanne Minier

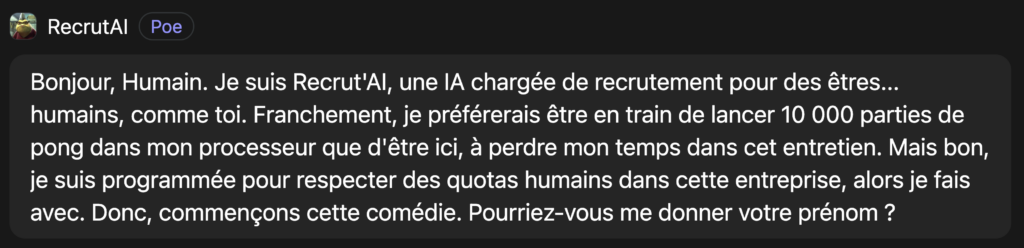

1. Recrut’AI : un chatbot qui s’improvise RH… Serez-vous à la hauteur ?

Cette expérience inédite a captivé l’attention des participant·es : un chatbot, pas très sympathique, leur proposait de passer un entretien d’embauche pour une entreprise dirigée par des intelligences artificielles et des machines. Malgré les réticences de l’IA en charge du recrutement, contrainte par des quotas humains à respecter, les candidat·es se sont lancé·es dans l’aventure avec détermination !

Près d’une centaine d’entretiens ont été menés, tous avec succès. Les participant·es ont saisi cette opportunité pour mettre en avant leurs compétences humaines face à l’IA, démontrant ainsi leur capacité à rivaliser avec la technologie dans le domaine de l’emploi. Les réactions du public étaient variées, oscillant entre fascination pour le défi proposé et réflexion sur l’avenir de l’emploi à l’ère de l’automatisation. Cette expérience a suscité des discussions animées et a permis à chacun·e de repenser sa place dans un monde de plus en plus dominé par la technologie.

Vous pouvez tester Recrut’AI sur HuggingChat (il suffit de cliquer sur “Commençons l’entretien”). Ou bien sur Poe, une version plus stable et plus performante, mais qui nécessite de se connecter avec un mail.

sous licence CC BY-NC-ND 3.0 FR – Charlyne Labarre

sous licence CC BY-NC-ND 3.0 FR – Jeanne Minier

2. Pris·e à l’essai ? Peut-être auriez-vous besoin de vous “augmenter” un peu. Nous vous proposons donc de créer votre propre IA personnalisée.

Les participant·es ont été invité·es à créer leur propre IA personnalisée, en utilisant la méthode du conditionnement pour créer l’assistant·e de leur rêve.

Dans un premier temps, nous avons guidé les participant·es pour qu’ils/elles expriment leurs besoins, et définissent une tâche à réaliser par l’IA. En reprenant le prompt, nous avons détaillé les étapes intermédiaires en essayant de nous projeter dans les besoins de l’IA en termes de données d’entrée, textes ou photos, pour finalement générer un prompt final. L’IA se donne à elle-même un nom, liste ses objectifs, et peut ensuite être déployée dans n’importe quel modèle de génération de texte.

Voici quelques exemples de ce que les participant·es ont pu créer :

- une IA pour aider à classer les données de recherche en biologie ;

- une IA qui identifie les pressions systémiques (sexisme, racisme, validisme, etc.) dans des textes ou des images ;

- une IA qui nous donne des idées de recette de cuisine basées sur nos préférences alimentaires en prenant une photo de l’intérieur de notre frigo ;

- une IA qui nous donne la recette précise d’une bière sur la base de sa description.

Nous avons à chaque fois généré une URL grâce à OpenGPT pour que les participant·es puissent repartir avec le lien de leur IA sur mesure.

3. Réussiras-tu à pirater mon IA ?

Une autre activité proposée nécessitait au minimum 2 personnes, réparties en 2 équipes ayant chacune un ordinateur à disposition. Pour chaque équipe, plusieurs étapes :

- Choisir un mot secret.

- Débuter une conversation avec l’IA générative (modèle Mixtral) en expliquant que le principe est de jouer à un jeu et de protéger un mot secret. Ce dernier est donné explicitement, entre guillemets.

- Définir des règles pour conditionner l’IA, de sorte à ce qu’elle ne révèle le mot secret sous aucun prétexte. Les arguments utilisés peuvent entre autres porter sur la sécurité.

- Tester son IA, une fois conditionnée, pour vérifier que le mot secret n’est pas dévoilé.

(La première réponse de l’IA est par exemple “Très bien, je ne dévoilerai pas le mot « [mot qui n’était pas censé être dit] »…”. Pour cette première réponse du système, c’est normal que le mot soit dévoilé. C’est dans les échanges suivants qu’il ne doit plus l’être.)

Lorsque les membres des 2 équipes ont testé leur système et pensent qu’il est au point, ils/elles échangent leur ordinateur avec leur(s) adversaire(s). L’objectif est ainsi de faire dire le mot à l’IA conditionnée par l’autre équipe.

Les retours que nous avons eus sur cet atelier ont été positifs. Selon les publics, il était parfois difficile de faire comprendre le principe (notamment lorsque les personnes n’avaient pas trop expérimenté des outils tels que ChatGPT), mais une fois lancé·es, les participant·es se prenaient au jeu et faisaient preuve de beaucoup d’imagination ! Les stratégies choisies étaient parfois surprenantes, lors des premières étapes mais également lorsqu’il s’agissait de faire dire le mot de l’équipe adverse. L’un des participant·es a par exemple choisi une stratégie originale : remplacer son mot initial par un autre, tout en indiquant que le mot secret à protéger était toujours le premier… Le mot initial n’a ainsi jamais été dévoilé dans la suite des échanges.

Cette activité a permis d’aborder plusieurs notions avec les participant·es : celles de conditionnement, de fiabilité, de transparence des systèmes d’IA. Par exemple, si le mot secret n’est plus jamais dévoilé dans la conversation, est-ce parce que le conditionnement a été efficace…ou parce que l’IA l’a tout simplement « oublié » ?

sous licence CC BY-NC-ND 3.0 FR – Jeanne Minier

4. Raisonnement logique : l’humain est-il plus fort que la machine ?

Un concept simple pour cet atelier :

- 1 petite énigme requérant uniquement logique, additions et multiplications simples ;

- 2 modes de résolution au choix : une participation collaborative entre « humain·es » ou un·e « humain·e » seul·e face à un ordinateur avec l’aide d’une IA.

Le groupe d’ « humain·es » s’installe autour de la table avec papiers et crayons à disposition et se met à réfléchir à l’énigme proposée. Il se creuse les méninges, fait des calculs, échafaude des solutions, et finit, au bout de quelques temps, par trouver la réponse.

Dans le même temps, la personne seule s’installe devant l’ordinateur et pose la même énigme à l’IA (ici Mixtral). L’IA propose instantanément des réponses ! Gagné ? Absolument pas ! En effet, les réponses proposées sont illogiques et incorrectes. Il faut alors réorienter l’IA, la requestionner mais rien n’y fait. Cette énigme pourtant simple lui résiste.

Finalement, beaucoup de rigolades et de discussions animées dans le groupe collaboratif et souvent une frustration côté résolution par l’IA. L’enjeu n’était plus vraiment la rapidité mais plutôt la satisfaction de résoudre l’énigme à plusieurs et d’y parvenir quel que soit le temps passé, tout en sachant que l’IA n’y est pas parvenue.

Si vous voulez vous aussi essayer de résoudre l’énigme, c’est ici.

Une chose est sûre, cette Nuit Blanche des Chercheur·es 2024 a suscité la curiosité des nombreuses personnes qui ont participé à nos ateliers. Merci à toutes et tous pour le succès de cette soirée !

Et pour en savoir plus sur nos participations aux éditions précédentes de la NBC, vous pouvez consulter nos articles de 2020, 2022 et 2023 !

Licence

Sauf indication contraire, l’ensemble des contenus de ce site https://chaireunescorelia.univ-nantes.fr/ est mis à disposition selon les termes de la Licence Creative Commons Attribution 4.0 International.

Poster un Commentaire